神经网络(Chap.7)

复制本地路径 | 在线编辑

神经网路,CS229 讲的还可以。Update: 似乎太基础了...

入门与熟悉

- 从 7.2 节开始,首先是引入 activation functioin 这个概念,就是一个非线性函数而已,介绍了一个 RELU 函数,看到这里就可以打住了。

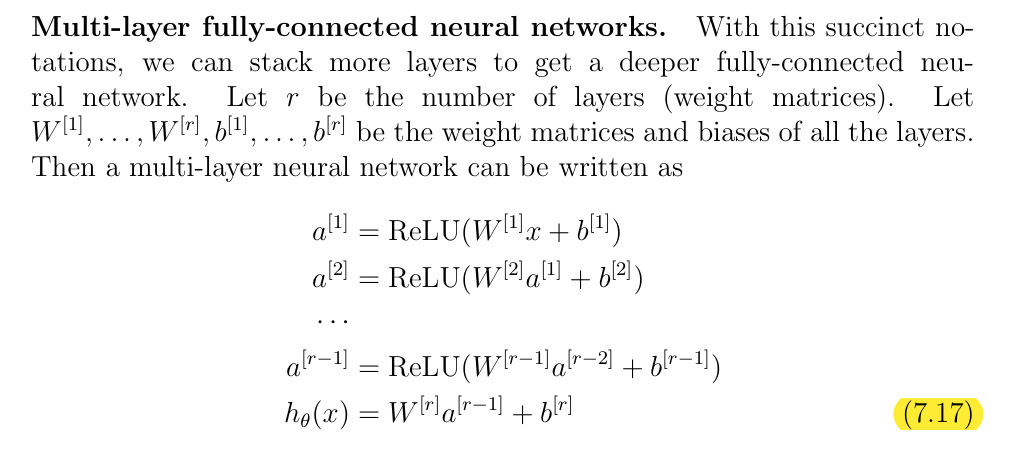

- 之后是对这个网络的向量表示,Eq.(7.12-7.17) 看一下就懂了,看这个是为了之后的讲解不会糊涂。

后向传播

花里胡哨的,其实后向传播就是修改网络中的 theta 参数呗。

- 看一下一层网络和二层网络的情况,7.3.2 和 7.3.3 讲的非常好。其实关键就是 Page.95 最后的那个公式,里面的项目可以重复利用。

一些杂项

下面都是一些其他的东西,无关紧要

- Page.90 说明了 [activation function] 不是随便取的,如果取 h(x) = x 是不可以滴

- Page.91 说明了和核函数的关系,实际上神经网络相当于自己提取了 features,非常滴好